Forscher haben einen entscheidenden Meilenstein in der Entwicklung von photonischen Quantencomputern erreicht und eine neue Methode demonstriert, um Fehler zu verhindern, bevor sie auftreten. Durch den Einsatz einer Technik namens Photonendestillation haben Wissenschaftler gezeigt, dass es möglich ist, „Rauschen“ in lichtbasierten Systemen zu mildern und damit eine große Hürde für den Bau großer, fehlertoleranter Quantencomputer zu nehmen.

Der photonische Vorteil und seine Achillesferse

Um diesen Durchbruch zu verstehen, muss man zunächst den grundlegenden Unterschied zwischen den beiden führenden Arten des Quantencomputings verstehen:

- Supraleitende Quantencomputer: Diese nutzen elektronische Schaltkreise, um Qubits zu erzeugen. Obwohl sie leistungsstark sind, erzeugen sie erhebliche Wärme und erfordern für ihre Funktion eine extreme Kühlung bis nahe an den absoluten Nullpunkt.

- Photonische Quantencomputer: Diese nutzen Lichtteilchen (Photonen ) als Qubits. Da Photonen ständig in Bewegung sind, erzeugen sie nur sehr wenig überschüssige Wärme, sodass diese Systeme möglicherweise bei Raumtemperatur betrieben werden können.

Allerdings ist diese Mobilität ein zweischneidiges Schwert. Da sich Photonen mit Lichtgeschwindigkeit bewegen und über komplexe optische Wege (Spiegel und Strahlteiler) interagieren, sind sie unglaublich „spröde“. In einem photonischen System sind Fehler häufig auf „Schurkenphotonen“ zurückzuführen – Teilchen, die nicht richtig mit anderen interagieren und praktisch als nutzloses Rauschen durch das System treiben.

Die Herausforderung: Fehler vor der Berechnung

In den meisten Quantensystemen erfolgt die Fehlerkorrektur nachdem ein Fehler gemacht wurde. Dies ist für lichtbasierte Systeme problematisch, da die Fehler häufig auftreten, bevor das Photon überhaupt als Qubit verarbeitet wird.

Wie Jelmer Renema, Chefwissenschaftler bei QuiX Quantum, erklärt, ist photonisches Computing von Natur aus probabilistisch. Wenn Forscher Licht manipulieren, verwalten sie im Wesentlichen Wahrscheinlichkeiten. Ohne eine Möglichkeit, die „schlechten“ Photonen herauszufiltern, sinkt die Wahrscheinlichkeit einer erfolgreichen Berechnung jedes Mal, wenn Sie dem System weitere Komponenten hinzufügen. Bei der herkömmlichen Skalierung führt das Hinzufügen weiterer Qubits oft zu mehr Fehlern als es löst, wodurch eine mathematische Mauer entsteht, die verhindert, dass Computer größer oder nützlicher werden.

Die Lösung: Photonendestillation

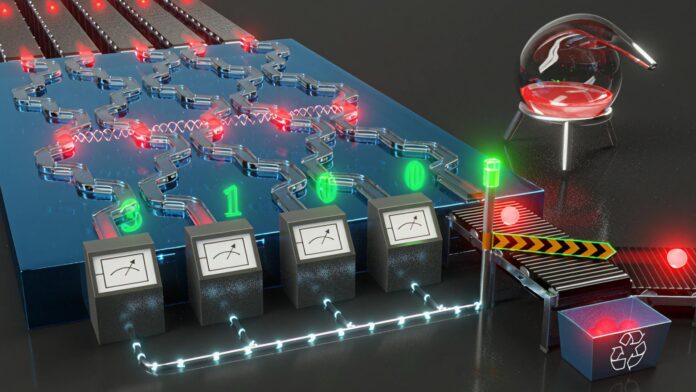

Der in einer aktuellen Studie beschriebene Durchbruch betrifft einen Prozess namens Quantenphotonische Destillation. Anstatt zu versuchen, eine fehlerhafte Berechnung zu reparieren, fungiert diese Methode als High-Tech-Filter.

So funktioniert es:

- Quanteninterferenz: Das System nutzt spezielle optische Schaltkreise, um „Quanteninterferenz“ auszunutzen – ein Phänomen, bei dem die Wahrscheinlichkeiten verschiedener Quantenzustände kombiniert werden.

- Filterung von „Rogue“-Photonen: Die Schaltung ist so konzipiert, dass die Wahrscheinlichkeit, dass ein „Rogue“-Photon den Ausgang erreicht, deutlich geringer ist als die Wahrscheinlichkeit, dass ein „gutes“ Photon durchgeht.

- Nettopositive Skalierung: Dieser Prozess erzeugt hochwertige Photonen, bevor sie für die Berechnung verwendet werden.

Das wichtigste Ergebnis ist, dass mit dieser Technik eine Fehlerminderung unterhalb des Schwellenwerts erreicht wird. Das bedeutet, dass der Destillationsprozess die Fehlerrate effektiver reduziert, als die neuen Komponenten sie erhöhen, wenn das System skaliert und komplexer wird.

Warum das für die Zukunft wichtig ist

Während Unternehmen wie Google mit supraleitenden Prozessoren ähnliche Meilensteine „unterhalb der Schwelle“ erreicht haben, ist dies das erste Mal, dass eine solche Leistung in einem lichtbasierten System erreicht wurde.

Die Auswirkungen sind tiefgreifend: Wenn Forscher qualitativ hochwertige Qubits ohne den enormen „Overhead“ (die enorme Menge an zusätzlicher Hardware, die normalerweise zur Korrektur von Fehlern erforderlich ist) erhalten können, werden die Kosten und die Komplexität des Aufbaus eines universellen Quantencomputers erheblich sinken. Dadurch wird das photonische Computing von einer theoretischen Möglichkeit hin zu einer praktikablen, skalierbaren Technologie, die in der Lage ist, die leistungsstärksten Supercomputer von heute zu übertreffen.

Dieser Durchbruch zeigt, dass wir über die „probabilistische“ Natur des Lichts hinausgehen und eine vorhersehbare, skalierbare Architektur für die nächste Computergeneration schaffen können.

Schlussfolgerung

Durch das Herausfiltern von Fehlern an der Quelle durch Photonendestillation haben Wissenschaftler einen Fahrplan für die Skalierung lichtbasierter Quantencomputer erstellt. Diese Entwicklung deutet darauf hin, dass Hochleistungs-Quantencomputing bei Raumtemperatur viel näher an der Realität sein könnte als bisher angenommen.