Les chercheurs ont franchi une étape critique dans le développement des ordinateurs quantiques photoniques, en démontrant une nouvelle méthode permettant de prévenir les erreurs avant qu’elles ne surviennent. En utilisant une technique connue sous le nom de distillation de photons, les scientifiques ont montré qu’il est possible d’atténuer le « bruit » dans les systèmes basés sur la lumière, éliminant ainsi un obstacle majeur à la construction d’ordinateurs quantiques à grande échelle et tolérants aux pannes.

L’avantage photonique et son talon d’Achille

Pour comprendre cette avancée, il faut d’abord comprendre la différence fondamentale entre les deux principaux types d’informatique quantique :

- Ordinateurs quantiques supraconducteurs : Ceux-ci utilisent des circuits électroniques pour créer des qubits. Bien que puissants, ils génèrent une chaleur importante et nécessitent un refroidissement extrême jusqu’à un niveau proche du zéro absolu pour fonctionner.

- Ordinateurs quantiques photoniques : Ceux-ci utilisent des particules de lumière (photons ) comme qubits. Étant donné que les photons sont en mouvement constant, ils génèrent très peu de chaleur excessive, ce qui permet à ces systèmes de fonctionner potentiellement à température ambiante.

Toutefois, cette mobilité est une arme à double tranchant. Parce que les photons se déplacent à la vitesse de la lumière et interagissent via des chemins optiques complexes (miroirs et séparateurs de faisceaux), ils sont incroyablement « fragiles ». Dans un système photonique, les erreurs proviennent souvent de “photons indésirables” : des particules qui ne parviennent pas à interagir correctement avec les autres, dérivant effectivement à travers le système sous forme de bruit inutile.

Le défi : les erreurs avant le calcul

Dans la plupart des systèmes quantiques, la correction d’erreur se produit après qu’une erreur ait été commise. Ceci est problématique pour les systèmes basés sur la lumière, car les erreurs se produisent souvent avant même que le photon ne soit traité comme un qubit.

Comme l’explique Jelmer Renema, scientifique en chef chez QuiX Quantum, l’informatique photonique est intrinsèquement probabiliste. Lorsque les chercheurs manipulent la lumière, ils gèrent essentiellement des probabilités. Sans moyen de filtrer les « mauvais » photons, la probabilité d’un calcul réussi diminue à chaque fois que vous ajoutez des composants au système. Dans la mise à l’échelle traditionnelle, l’ajout de qubits introduit souvent plus d’erreurs qu’il n’en résout, créant un mur mathématique qui empêche les ordinateurs de devenir plus grands ou plus utiles.

La solution : la distillation de photons

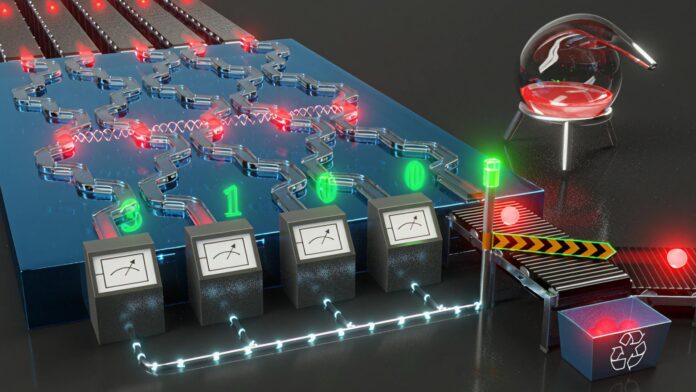

La percée détaillée dans une étude récente implique un processus appelé distillation photonique quantique. Au lieu d’essayer de réparer un calcul erroné, cette méthode agit comme un filtre high-tech.

Comment ça marche :

- Interférence quantique : Le système utilise des circuits optiques spécialisés pour exploiter les « interférences quantiques », un phénomène dans lequel les probabilités de différents états quantiques se combinent.

- Filtrage des photons « voyous » : Le circuit est conçu de telle sorte que la probabilité qu’un photon « voyous » atteigne la sortie est nettement inférieure à la probabilité qu’un « bon » photon passe à travers.

- Mise à l’échelle nette positive : Ce processus produit des photons de haute qualité avant qu’ils ne soient utilisés pour le calcul.

La découverte la plus significative est que cette technique permet d’obtenir une “atténuation des erreurs en dessous du seuil”. Cela signifie qu’à mesure que le système évolue et devient plus complexe, le processus de distillation réduit le taux d’erreur plus efficacement que les nouveaux composants ne l’augmentent.

Pourquoi c’est important pour l’avenir

Alors que des entreprises comme Google ont atteint des étapes similaires « en dessous du seuil » avec des processeurs supraconducteurs, c’est la première fois qu’un tel exploit est accompli dans un système basé sur la lumière.

Les implications sont profondes : si les chercheurs parviennent à maintenir des qubits de haute qualité sans les “surcharges” massives (l’énorme quantité de matériel supplémentaire généralement requise pour corriger les erreurs), le coût et la complexité de la construction d’un ordinateur quantique universel diminueront considérablement. Cela fait passer l’informatique photonique d’une possibilité théorique à une technologie viable et évolutive, capable de surpasser les supercalculateurs les plus puissants d’aujourd’hui.

Cette avancée démontre que nous pouvons dépasser la nature « probabiliste » de la lumière pour créer une architecture prévisible et évolutive pour la prochaine génération d’informatique.

Conclusion

En filtrant les erreurs à la source grâce à la distillation de photons, les scientifiques ont fourni une feuille de route pour la mise à l’échelle des ordinateurs quantiques basés sur la lumière. Ce développement suggère que l’informatique quantique haute performance à température ambiante pourrait être beaucoup plus proche de la réalité qu’on ne le pensait auparavant.